DC モーターから BLDC へ。駆動輪の回転量を測れる球体型ロボット。

従来 omicro の DC モーターは、低速域での回転量制御が困難で、球体型ロボットの構造上、停止制御も難しい課題でした。XR との同期にはこの精度が足りない。omicro Flux ではモーターを M5Stack 製 BLDC Roller485 に置き換え、内蔵された角度センサで駆動輪の回転量を測定。PID 制御で低速の回転を精密に制御できるようになりました。

姿勢検出は 9 軸 IMU(M5Stack Unit Pro)に変更。地磁気センサ単体では難しかった会場環境での磁場の影響を補正し、安定した方位検出と姿勢推定を実現します。フレームは Roller485 と Unit Pro の重心バランスに合わせて全て再設計し、駆動輪は表面が滑らかな Black Resin、Ring LED カバーは透明で寸法安定性に優れた 8001 Resin を採用。

omicro Flux 自体は群制御を内蔵しません。単体ロボットとして高精度な制御を確立し、将来的に複数の球体型ロボットを「新しい車輪」として動かす上位システム(Boundary Blur など)の土台になることを目指しています。M5Stack Global Innovation Contest 2025 で特別賞・ベストロボティクスを受賞。

omicro Flux · BLDC Roller485 と Unit Pro が中央に。

物理と仮想を、双方向に動かしあう。

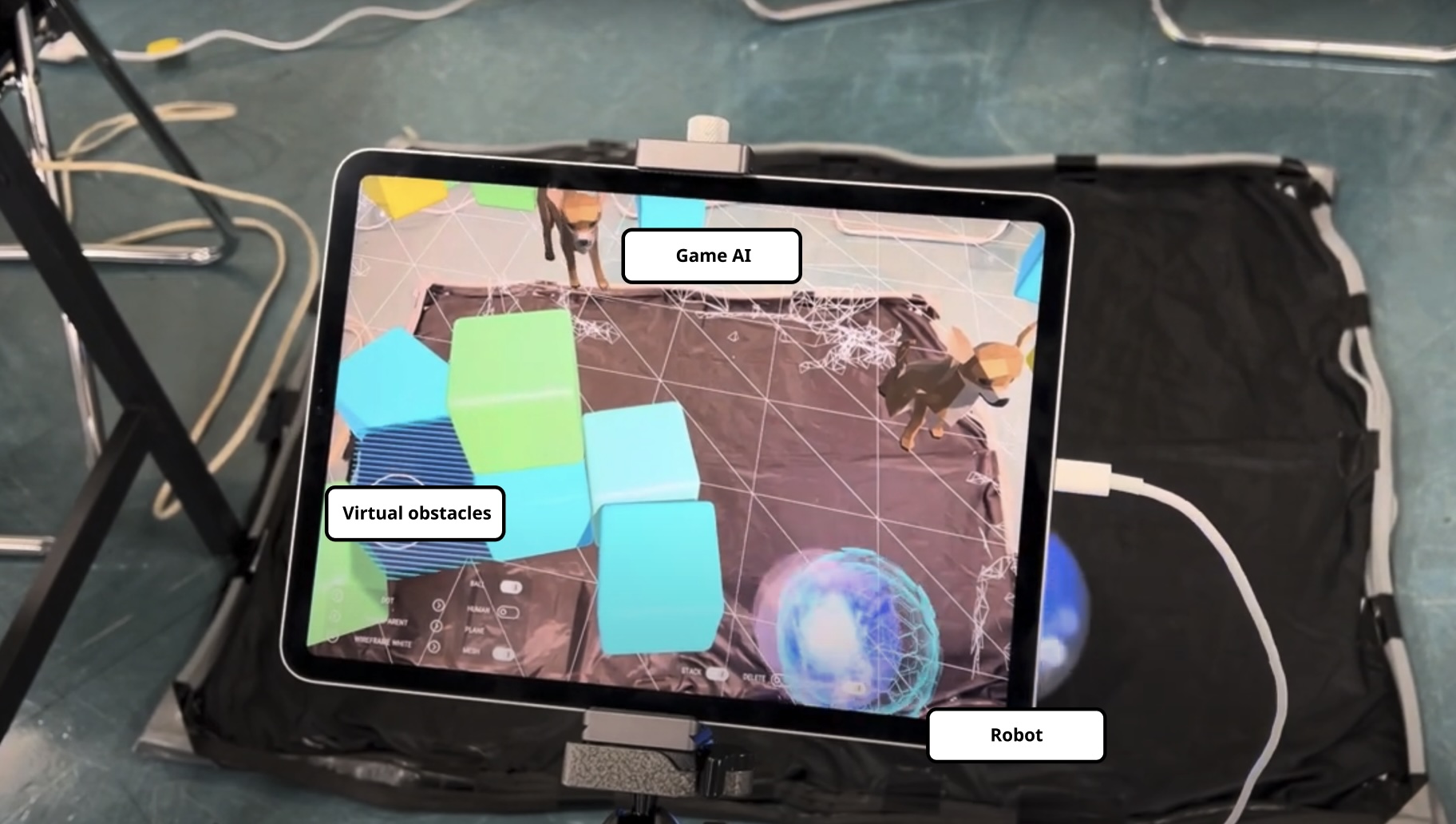

iPad Pro の LiDAR と ARFoundation で部屋の床・壁をメッシュ化し、その上にデジタルツインの世界を構築します。omicro の位置取得には OpenCV を用い、球体下部の青色 LED を 2 値化処理で追跡。取得した中心座標に対して ARFoundation で Raycast を実行し、奥行きを取得して AR 空間にロボットのデジタルツインを配置します。

デジタルツインが仮想オブジェクトと衝突すると、その状態が現実の omicro に 停止コマンドとして返ります。逆に、現実の omicro が地磁気センサで取得した方位は iOS 経由で Unity に渡され、デジタルツインの向きを更新します。追尾するゲーム AI がデジタルツインに接触すると、現実の omicro が回避行動を起こす ── 仮想と物理が同じレイヤーで影響し合うシステムです。

運用側では、床に黒シートを敷いて反射を減らし、iPad Pro を地上 130cm 前後で固定、OpenCV の 2 値化色範囲と ARFoundation 検出位置の補正を環境光に合わせて調整します。Apple Vision Pro 連携や複数ロボット協調を視野に入れ、omicro Flux の高精度制御がここに乗ります。

Boundary Blur · Unity の AR ビュー。空間メッシュとデジタルツイン。

170mm のクリア球に、内壁を駆け上がるロボット。

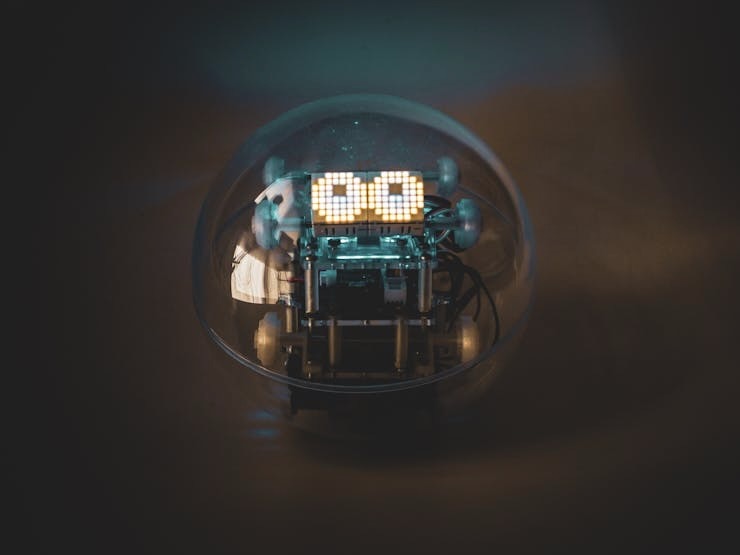

シリーズの初代機。直径 170mm のクリアなプラスチック球(スチロール樹脂、表面に硬化ガラスコーティング)の中に、M5Stamp S3 をマイコンとして、モータードライバ SparkFun TB6612FNG、6 軸センサ MPU6050、Grove 三軸デジタルコンパス、マトリックス LED ×2、NeoPixel Ring 16 連、エネループ電池 6 本を収めています。

車輪は合計 10 個。動力は下部の大きな 2 つの駆動輪のみ。残り 8 つは静止時に内壁から離れているが、走行時に接触して直進安定性・衝撃吸収・回転時の軸保持を担う、いわば「補助輪」です。ゴムタイヤと球体の摩擦が強すぎるため 医療用サージカルテープでグリップを調整。両輪を逆方向に回せば超信地旋回、その場で 360° 向き変更が可能です。

iPhone・iPad・Apple Watch から BLE 経由で操作可能、複数台同時制御に対応。完全保護されたクリア球の構造で衝突・転倒に強く、教育現場・家庭・ワークショップ・展示と、人がいる空間で動かせる堅牢性を備えています。

omicro · 二つの駆動輪と八つの補助輪、内部のフレーム。

シリーズの神経系。複数台と Watch と Unity を 1 つに束ねる。

iOS アプリは システムハブとして機能し、複数の omicro/omicro Flux、watchOS アプリ、Unity アプリの間の通信をすべて CoreBluetooth で一元管理します。ロボットから受け取った角度情報を Unity に送信し、Unity からの衝突判定フラグをロボットに返す ── プロトコルの差異を吸収して統一された制御コマンドに変換する司令塔です。

watchOS アプリの目玉は ハンドモーション機能。Apple Watch のジャイロ・加速度センサで手の動きを読み取り、素早く水平に上げると機能 ON、水平から 20° 上げると前進、左右に捻ると左右回転、素早く下げると OFF。さらに CoreML の Activity Classification で複雑なハンドジェスチャを学習・認識し、より細かい操作にも対応します。

omicro Flux 対応版では、BLDC モーターの精密制御に対応した新しい制御インターフェース、改良された回転量・移動量制御、押し込み量で加速減速を制御する触覚フィードバック対応のジョイスティック制御を実装。単純な ON/OFF ではなく、内部的に最適な値に変換するアルゴリズムが噛んでいます。

omicro Apps · Apple Watch のハンドモーションで操作。

Apple Watch のジェスチャ、iPhone のハブ、iPad Pro の AR、そして球体の中の omicro。それぞれ独立したデバイスを CoreBluetooth で束ね、Sense → Decide → Roll の 3 フェーズで閉じたループを回します。

球体内部の 9 軸 IMU が姿勢と方位を、Apple Watch の CoreMotion がユーザーの手の動きを、iPad Pro の LiDAR が空間を、OpenCV が球体 LED の位置を、それぞれ独立して読み取ります。

iOS アプリがロボット・watchOS・Unity・ゲーム AI を CoreBluetooth で 1 つの BLE ネットワークに統合。プロトコルの差異を吸収し、各レイヤーの状態を統合制御コマンドに変換して再分配します。

omicro Flux では M5Stack BLDC Roller485 と PID 制御が、内蔵角度センサで駆動輪の回転量を測りながら回します。両輪逆回転で超信地旋回(pivot turn)、その場での向き変更も精密に制御。

Maker Faire を中心に、世界各地で展示・登壇してきました。観客の前で実機を動かすことが、そのまま開発のリズムになっています。

omicro はハードと制御を作り直しながら続けている個人プロジェクトです。これまでの主な動きと、次に取り組むことをまとめました。